Acer Swift Go 16 AI, z 16 GB pamięci RAM i procesorem AMD Ryzen 7 350, przeszedł ostatnio nasze testy. Dodatek "AI" w nazwie sugeruje, że laptop ten jest gotowy na aplikacje AI. Nasza recenzjasugeruje jednak, że pamięć może być raczej niewystarczająca do tego zastosowania. Niemniej jednak, modele językowe, generatory obrazów i narzędzia wideo stają się coraz potężniejsze i nadal wymagają mniej pamięci RAM. Na papierze, niektóre interesujące modele sztucznej inteligencji mogłyby działać na pamięci laptopa. Przetestowaliśmy je.

Najnowsza wersja systemu Windows 11 zawiera już kilka narzędzi AI, z których niektóre działają lokalnie, a inne na serwerach Microsoft. Niestety, nie zawsze jest jasne, skąd Copilot i inne czerpią swoją moc obliczeniową. Aplikacja Copilot konsekwentnie wymaga aktywnego połączenia z Internetem. Niektóre funkcje w aplikacji Zdjęcia działają lokalnie bez połączenia z Internetem, podczas gdy inne wymagają konta Microsoft i nie działają w trybie offline. Ulepszenia jakości obrazu i dźwięku z nagrań z kamery internetowej są obsługiwane lokalnie przez NPU (Neural Processing Unit). Przywrócono również funkcję Microsoft Recall, która wywołała pewne kontrowersje. Pozostaje ona jednak domyślnie wyłączona i może być używana tylko wtedy, gdy włączone jest szyfrowanie urządzenia i ochrona hasłem. Wiele innych funkcji sztucznej inteligencji w systemie Windows nie jest szczególnie zauważalnych lub działa tylko z pakietem Microsoft Office.

Aby lokalnie korzystać z alternatywnych modeli językowych i narzędzi do generowania obrazów, potrzebne jest specjalne oprogramowanie. Jednak proces uruchamiania tych programów na komputerze domowym nie jest już tak uciążliwy, jak jeszcze rok temu. Obecnie dostępne jest proste oprogramowanie, które instaluje się szybko i otwiera przed użytkownikiem wiele możliwości. Amuse oferuje oprogramowanie do generowania i edycji obrazów AI, specjalnie dostosowane do sprzętu AMD w Acer Swift Go 16 AI. LM Studio zapewnia wygodny sposób korzystania z SLM (małych modeli językowych) - zasadniczo sztucznej inteligencji do generowania tekstu. FastFlowLM nie jest tak wygodny w użyciu, ale działa bardziej energooszczędnie na NPU. Zainstalowaliśmy wszystkie trzy programy na naszym urządzeniu testowym. Jednak Acer Swift Go 16 AI, którego używaliśmy, nie jest niestety optymalnie wyposażony w zaledwie 16 GB pamięci. System Windows i wstępnie zainstalowane programy Acer szybko zużywają od sześciu do dziewięciu gigabajtów ograniczonej pamięci. Pozostawia to około 10 GB pamięci dostępnej dla AI. Amuse określa, że do wykorzystania jest około 8 GB pamięci. LM Studio szacuje 15 GB, ale zawiesza się za każdym razem, gdy próbujemy załadować wystarczająco duży model językowy.

AMUSE - Edycja i generowanie obrazów AI

Korzystaliśmy z Amuse w najnowszej wersji w czasie testów (3.1). Oprogramowanie jest darmowe i instaluje się wygodnie. Obsługiwana jest tutaj jednostka NPU procesora AMD, co powinno znacznie przyspieszyć pracę ze sztuczną inteligencją, nawet bez dedykowanego GPU. Oprócz generowania tekstu na obraz, oferuje również funkcje obraz-wideo i obraz-obraz.

Aby faktycznie generować obrazy, należy najpierw zainstalować Amuse, a następnie załadować odpowiednie modele. Odbywa się to za pomocą programu, co jest stosunkowo proste, ale czasochłonne, ponieważ każdy model zawiera kilka gigabajtów danych. Spośród trzech presetów oferowanych przez Amuse w trybie dla początkujących, opcja "Balanced" nie sprawdza się w naszym przypadku. tryby "Fast" i "Quality" jednak działają, choć tylko tryb szybki działa naprawdę bezproblemowo. Tryb "Szybki" opiera się na małym Dreamshaper LCM Turbo. Mieści się on w ograniczonej pamięci laptopa i działa bardzo szybko. Obrazy generowane są w ciągu kilku sekund. W trybie eksperckim działają również StableDiffusion XL Turbo i StableDiffusion 3. Ten ostatni może być nawet odciążony do NPU. Jednak oba modele w pełni wykorzystują pamięć laptopa i nie działają szybko. Wykorzystanie pamięci jest szczególnie problematyczne po uruchomieniu Amuse, nic innego na laptopie nie działa płynnie. W poważnych przypadkach Amuse nawet się zawiesza, jeśli okno przeglądarki w tle wymaga zbyt dużo pamięci. Jedynie korzystanie z małego Dreamshaper LCM jest przyjemne. Mimo to daje on stosunkowo dobre rezultaty. Jednak jego korzenie są wyraźnie widoczne w Stable Diffusion 1.5. Jeśli nie zwrócimy uwagi na podpowiedzi, zobaczymy wiele rozmytych krawędzi i dziwnych proporcji. Ale Dreamshaper LCM jest również niesamowicie szybki. W mgnieniu oka model ten może tworzyć obrazy. Tutaj ilość jest ważniejsza od jakości. Gdy obraz jest już w miarę zadowalający. Jakość można następnie poprawić w Amuse za pomocą edycji obrazu do obrazu.

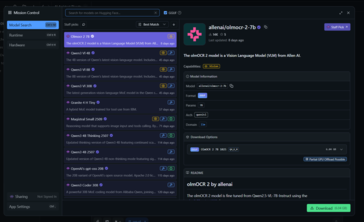

LM Studio - Chatboty, modele rozumowania i nie tylko

LM Studio to system zarządzania i wykonywania modeli językowych. Na laptopie, pochodne ChatGPT, Llama, Qwen3 i inne mogą być uruchamiane lokalnie. Podobnie jak w przypadku Amuse, czynnikiem ograniczającym Acer Swift Go 16 AI wydaje się być skromna pamięć, a nie moc obliczeniowa. Nowy gpt-oss 20B OpenAI zawiesza się podczas ładowania z powodu niewystarczającej ilości pamięci. Bazując na doświadczeniu, możemy potwierdzić, że model ten działa bezbłędnie na laptopach z AMD Ryzen 9 370 i 32 GB pamięci.

Qwen3 Vi 8B, Qwen3 4B Thinking i IBM Granite 4 H Tiny (Q4_K_M i Q8_0) działały zaskakująco dobrze na laptopie Acer. Najmniejszy model językowy IBM jest niezwykle szybki i błyszczy wystarczającymi odpowiedziami. Qwen3 Vi 8B imponuje bardzo naturalnym tonem mowy i wykazuje szczególne zalety w przetwarzaniu obrazu. Dla osób o słabszym wzroku taka sztuczna inteligencja może stanowić doskonałą pomoc na laptopie. Model rozumowania Qwen3 4B Thinking jest najwolniejszy w naszych testach, gdy mamy do czynienia z czysto tekstowymi odpowiedziami. Ale przede wszystkim odpowiedzi robią wrażenie. W zależności od złożoności pytania, otrzymanie odpowiedzi od Qwen3 może zająć do pięciu minut. Oczywiście można obserwować proces myślenia i natychmiast interweniować, jeśli odpowiedź pójdzie całkowicie w złym kierunku.

Wiele innych mniejszych modeli językowych również powinno działać dobrze na naszym urządzeniu testowym. Jednak każdy model językowy zużywa również znaczną ilość miejsca na dysku SSD. Należy spodziewać się od 3 do 7 GB na model językowy. Małe modele SLM (Small Language Models) okazują się zaskakująco wszechstronne.

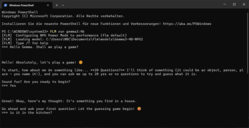

AI w podróży - FastFlowLM z pełną obsługą AMD-NPU

Osoby korzystające z LM Studio w podróży muszą niestety liczyć się z szybkim wyczerpaniem baterii. LM Studio wykorzystuje zarówno CPU, jak i GPU do wszystkich obliczeń. Energooszczędna jednostka NPU w naszym Ryzenie 7 350 pozostała niestety nietknięta. FastFlowLM pozwala wykorzystać wydajność NPU układu AMD. Wiąże się to ze znacznie niższym zużyciem energii, mimo że LLM nie działa zauważalnie wolniej na NPU. Jakość danych wyjściowych pozostaje niezmieniona. FastFlowLM jest jednak nieco trudniejszy w użyciu niż LM Studio, ponieważ nie posiada własnego graficznego interfejsu użytkownika. Graficzny interfejs użytkownika dla FastFlowLM można uzyskać za pośrednictwem Open WebUI. W przeciwnym razie jest on używany za pośrednictwem Windows PowerShell. Chociaż może to być wyjątkowe doświadczenie.

Dla porównania, zmierzyliśmy zużycie energii laptopa podczas korzystania z Gemma3:4b z LM Studio i FastFlowLM. W przypadku FastFlowLM maksymalny pobór mocy laptopa wynosił około 25 watów. Znacznie wyższe było zużycie energii podczas korzystania z tego samego modelu za pośrednictwem LM Studio. Zmierzyliśmy pobór mocy około 65 watów. W obu przypadkach wydajność (w tokenach na sekundę) nadal znacznie przekraczała 10 tokenów na sekundę. W zależności od sposobu obliczenia, Gemma3:4b osiąga około 250 do 600 słów na minutę przy 10 tokenach/s. Z reguły 1,8 tokena odpowiada niemieckiemu słowu, a 1,3 tokena angielskiemu słowu. Przeanalizowaliśmy niemieckie teksty stworzone przez Gemmę i uzyskaliśmy około 450 słów na minutę. To znacznie szybciej niż w przypadku typowego czytelnika.

Wniosek - lokalna sztuczna inteligencja jest możliwa, ale nie zawsze użyteczna

Funkcje Windows AI działają bezbłędnie na Acer Swift Go 16 AI. Co zaskakujące, odpowiedzi z SLM, takich jak Gemma3, Qwen3 i Granite 4, pojawiają się na ekranie szybko, ale z różną jakością w zależności od modelu i zadania. Każdy, kto zdecydowanie chce korzystać z modeli Text2Image i innych funkcji Amuse, powinien prawdopodobnie zdecydować się na laptopa z większą ilością pamięci. Acer Swift Go 16 AI Acer Swift Go 16 AI jest również dostępny z 32 GB pamięci RAM.

Ostatecznie sztuczna inteligencja jest wciąż w powijakach. Oprogramowanie, które jest łatwe w użyciu i wykorzystuje możliwości AMD NPU, jeszcze nie istnieje. Szkoda, ponieważ wydajność, którą udało nam się osiągnąć przy odrobinie majsterkowania, była szczególnie imponująca. Nawet Amuse pokazuje obiecujący potencjał na laptopie, ale jak na nasz gust, generuje zbyt wiele komunikatów o błędach i czasami jest dość powolny.

Pokazały to przede wszystkim nasze testy: Jeśli chcą Państwo efektywnie korzystać z funkcji AI, potrzebują Państwo dużo szybkiej pamięci RAM. Najlepsza sztuczna inteligencja jest bezwartościowa, jeśli wszystkie inne programy, takie jak Word i przeglądarki, zawieszają się podczas korzystania z funkcji sztucznej inteligencji.