Dyrektor generalny Epic Tim Sweeney niedawno ostrzegł że rynek komputerów do gier klasy premium będzie zagrożony przez wygórowane ceny pamięci graficznych w dającej się przewidzieć przyszłości.

Producenci komputerów PC i laptopów po prostu nie mogą konkurować z ceną, jaką juggernauci sztucznej inteligencji, tacy jak Nvidia, Google, Meta i inni, są skłonni zapłacić, aby rozwijać swoje wysokiej klasy projekty GPU i centrów danych sztucznej inteligencji, ostrzegł Sweeney. Jego ostrzeżenie pojawiło się jako komentarz do podwyżek cen pamięci RAM, które mają miejsce, a jeden z użytkowników skarżył się, że ta sama jednostka 64 GB Crucial RAM, którą kupili za 240 USD miesiąc temu, teraz wzrosła ponad dwukrotnie do prawie 500 USD. Amazon ma obecnie w sprzedaży dwa moduły 32 GB w lepszej cenie, która wciąż jest znacznie wyższa niż w październiku.

Cena pamięci HBM4 Samsung i SK Hynix dla Nvidii

Przypadkowo, 500 USD to dokładnie tyle, ile Nvidia podobno przygotowuje się zapłacić zarówno Samsungowi, jak i SK Hynix za ich następną generację HBM4 w 2026 roku. Według osób z branży, producenci pamięci pobierają od Nvidii do 100% więcej, ponieważ mogą. Koszty produkcji pamięci HBM4 firmy SK Hynix wzrosną o 50%, ponieważ musi ona produkować podstawową matrycę w TSMC, ale cały ten wzrost zostanie przeniesiony na Nvidię. Obecnie SK Hynix sprzedaje swoje 12-warstwowe moduły pamięci HBM3E firmie Nvidia za około 350 USD za sztukę, podczas gdy Samsung wycenia je o 100 USD mniej, ponieważ spóźnił się na imprezę z powodu problemów z certyfikacją.

W 2026 roku, high-endowa pamięć HBM4 dla chipów AI Nvidii będzie wyceniana w połowie 500 USD, co dla Samsunga będzie ponad dwukrotnie więcej niż za poprzednika HBM3E."Zapotrzebowanie Nvidii na HBM4 jest tak wysokie, że Samsung Electronics nie ma innego wyjścia, jak tylko zabezpieczyć jego dostawy po wysokiej cenie" - radzą wtajemniczeni. Nie trzeba dodawać, że może to również skutkować wyższymi cenami Nvidii, ponieważ nie brakuje popytu na jej GPU.

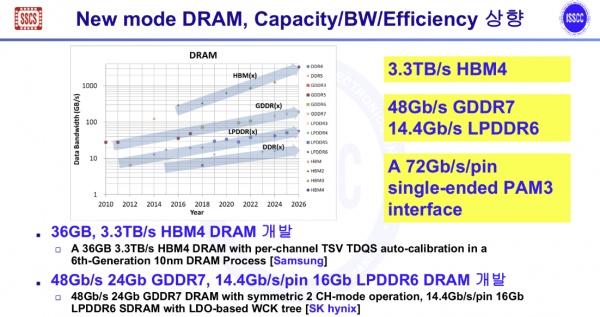

Specyfikacje pamięci GDDR7 i LPDDR6 SK Hynix

Oprócz ceny pamięci Samsung HBM4, źródła branżowe szczegółowo opisały jej zmienioną specyfikację. Samsung najwyraźniej przeprojektował interfejs i architekturę stosu, aby osiągnąć przepustowość 3,3 TB/s dla modułu o pojemności 36 GB. Ulepszenia obejmują"lepszą dokładność sygnału w szybkich sekcjach poprzez zastosowanie automatycznej kompensacji sygnału wyrównania (TDQS) specyficznej dla kanału ścieżki przelotki krzemowej (TSV)" lub tej, która przetwarza akcelerator AI i ruch specyficzny dla LLM. Dla porównania, obecne moduły HBM3E, które Samsung sprzedaje Nvidii, mają specyfikację 1,2 TB/s, więc moduł HBM4 będzie oferował ponad dwukrotnie większą przepustowość za dwukrotnie niższą cenę.

Oprócz nowych szczegółów specyfikacji HBM4, przedstawiciel SK Hynix powtórzył również specyfikacje swoich pamięci LPDDR6 i GDDR7. Mobilne moduły pamięci DRAM LPDDR6 oferują przepustowość 14,4 Gb/s na każdym pinie, z nową technologią regulatora niskiego napięcia, która utrzymuje stabilny sygnał przy zwiększonych prędkościach. Z kolei moduły pamięci graficznej GDDR7 o pojemności 24 GB będą przeznaczone do zaawansowanych gier i zadań związanych z wnioskowaniem w sztucznej inteligencji z prędkością 48 Gb/s na pin, czyli trzykrotnie większą niż obecna przepustowość modułów GDDR6 SK Hynix.

Technologie pamięci nowej generacji HBM4, LPDDR6 i GDDR7 firm Samsung i SK Hynix zostaną zaprezentowane na konferencji International Solid-State Circuits Conference (ISSCC) w San Francisco w lutym. Oczekuje się, że Samsung zacznie dostarczać moduły HBM4 do Nvidii w drugim kwartale w przyspieszonym harmonogramie po dwukrotnie wyższej cenie niż obecnie, co prawdopodobnie oznaczałoby droższe procesory graficzne Nvidii w 2026 roku.

Proszę kupić kartę graficzną do gier ASUS ROG Astral GeForce RTX 5080 OC Edition na Amazon

Źródło(a)

Elec & Dealsite przez TrendForce